Cómo configurar balanceo de carga en la nube

Servidores al límite. Esa es la cruda realidad cuando tu sitio web en la nube se enfrenta a una avalancha de tráfico inesperado. Pensar que un solo servidor puede manejar todo es una ilusión cómoda, pero aquí viene la verdad incómoda: en el mundo del cloud hosting, una sobrecarga no solo frena tu negocio, sino que puede hundirlo por completo. Si sigues leyendo, aprenderás a configurar el balanceo de carga de manera efectiva, ganando escalabilidad y fiabilidad para que tu infraestructura en la nube sea tan resistente como un roble en una tormenta. Vamos a desmitificar esto con experiencias reales y consejos prácticos, porque en hosting en la nube, la preparación no es un lujo, es una necesidad.

¿Y si tu servidor hubiera tenido un compañero en aquella crisis?

Recuerdo vividly esa tarde en Madrid, cuando lancé mi primer proyecto de e-commerce en AWS. Había configurado todo con entusiasmo, pero olvidé el balanceo de carga, pensando que un solo servidor bastaría. "Total, ¿quién va a visitar un sitio nuevo de inmediato?", me dije, y justo ahí fue cuando… ya sabes lo que pasó. Un pico de tráfico por una promoción viral y, bam, el servidor se colapsó como un castillo de naipes. Fue una lección dura, pero me enseñó que en cloud hosting, distribuir la carga es clave para evitar el caos.

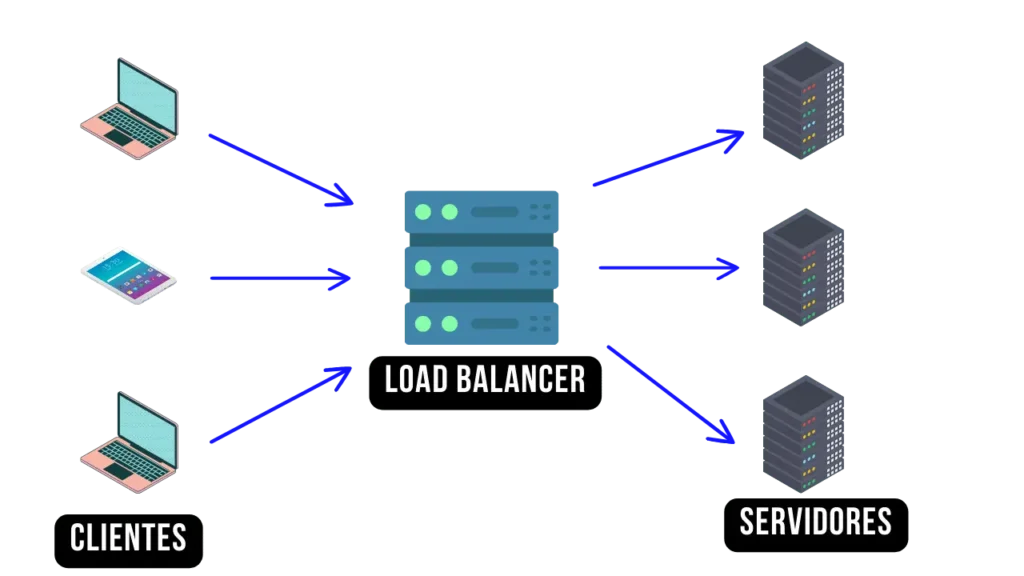

En mi experiencia, empezar con una historia real como esta ayuda a visualizar el problema. Para configurar balanceo de carga en plataformas como AWS, lo primero es entender que se trata de distribuir el tráfico entre múltiples servidores, o instancias, para mantener la disponibilidad. Usé Elastic Load Balancing (ELB) en AWS, y te juro que fue como echar una mano a un amigo en apuros. Configura un grupo de autoescalado: define políticas basadas en métricas como CPU o solicitudes por segundo. Por ejemplo, establece umbrales para que, si el tráfico sube, se lancen más instancias automáticamente. En Azure, es similar con Azure Load Balancer; crea un conjunto de escalado y reglas de equilibrio. La lección práctica aquí es probar en un entorno de staging primero, porque en hosting en la nube, un error en producción es como un gol en propia puerta – costoso y evitable.

¿Realmente crees que el balanceo de carga es solo para gigantes tecnológicos?

Hay un mito común en el mundo del cloud hosting: que el balanceo de carga es una herramienta exclusiva para empresas como Amazon o Google, algo demasiado complejo para el usuario promedio. Pero aquí viene la verdad incómoda: ignorar esto en tu setup puede dejar tu aplicación vulnerable, incluso si eres una startup o un freelancer. En mi opinión, basada en años lidiando con Google Cloud, este mito nace de la sobrecarga de términos técnicos, pero en realidad, es accesible y esencial.

Desmontémoslo. En Google Cloud, por ejemplo, el Cloud Load Balancing no requiere un doctorado en informática. Configúralo a través de la consola o la CLI: crea un balanceador HTTP(S) y asocia backend services con instancias de Compute Engine. La verdad es que, al igual que en la vida real, donde "no poner todos los huevos en una canasta" es un consejo sabio, aquí evitas que un solo punto de fallo derribe todo. Y para añadir un toque personal, en Latinoamérica, donde el internet puede ser tan impredecible como el clima en la selva, este setup ha salvado más de un proyecto mío de caídas inesperadas. No es perfecto – a veces, la latencia en regiones remotas complica las cosas –, pero es un paso fundamental para una infraestructura robusta en hosting en la nube.

Imagina el balanceo de carga como un coreógrafo en un ballet de datos

Esto es como dirigir un ballet de datos en la nube, donde cada servidor es un bailarín que debe sincronizarse a la perfección para evitar tropiezos. No es la comparación más común, pero piensa en ello: en un espectáculo como el de "Black Swan", un solo paso en falso arruina todo, igual que en cloud hosting, donde un servidor sobrecargado puede colapsar el sistema. En mi trayectoria, he visto cómo esta analogía inesperada ayuda a descomponer el proceso.

Para configurarlo en, digamos, Oracle Cloud Infrastructure, empieza por crear un load balancer y definir backends con instancias de Compute. Usa algoritmos como round-robin o least connections para distribuir el tráfico, y no olvides integrar con servicios de monitoreo como CloudWatch en AWS para ajustes en tiempo real. En un tono más técnico, pero humano, te diré que en hosting en la nube, esta configuración no solo escala tu aplicación, sino que la hace resiliente, como esa escena en "Inception" donde los sueños se pliegan sin colapsar. Prueba un experimento simple: simula tráfico con herramientas como Apache Bench y observa cómo el balanceo mantiene la estabilidad. Al final, es esa coreografía invisible la que asegura que tu sitio permanezca en pie, incluso cuando el público – es decir, los usuarios – crece de repente.

Al final del día, configurar balanceo de carga en la nube no es solo una técnica; es un cambio de mentalidad que transforma tu hosting de vulnerable a imbatible. Imagina si hubieras implementado esto desde el principio en mi anécdota inicial – habrías evitado horas de estrés. Ahora, te invito a aplicar lo que acabas de leer: elige una plataforma como AWS o Azure, configura un balanceador básico hoy mismo y prueba su impacto en tu setup. ¿Y tú, qué harías si un ciberataque repentino pusiera a prueba tu infraestructura en la nube mañana? Comparte tus pensamientos en los comentarios; podría ser el inicio de una conversación que salve a alguien más de un colapso.

Si quieres conocer otros artículos parecidos a Cómo configurar balanceo de carga en la nube puedes visitar la categoría Hosting en la Nube (Cloud Hosting).

Entradas Relacionadas